■ 전 세계적으로 AI에 대한 규제가 필요하다는 공감대가 형성되고 있음

AI 규제와 관련해서는 유럽연합(EU)이 가장 앞서 있고 미국도 최근 적극적인 모습을 보이고 있음

작게

보통

크게

AI 규제와 관련해서는 유럽연합(EU)이 가장 앞서 있고 미국도 최근 적극적인 모습을 보이고 있음

[EU]

○ 「AI법」은 AI의 윤리적 사용을 보장하여 시민 안전을 보호하고 AI 시스템과 인간의 상호작용에서 발생할 수 있는 위험에 대비하기 위해 제정된 법률

○ 2021년 EU 집행위원회가 최초로 법안을 제안한 이후, 2024년 2월 27개 회원국의 최종 합의를 거쳐 3월 유럽의회 본회의를 통과하고 5월 EU 이사회에서 최종 승인됨

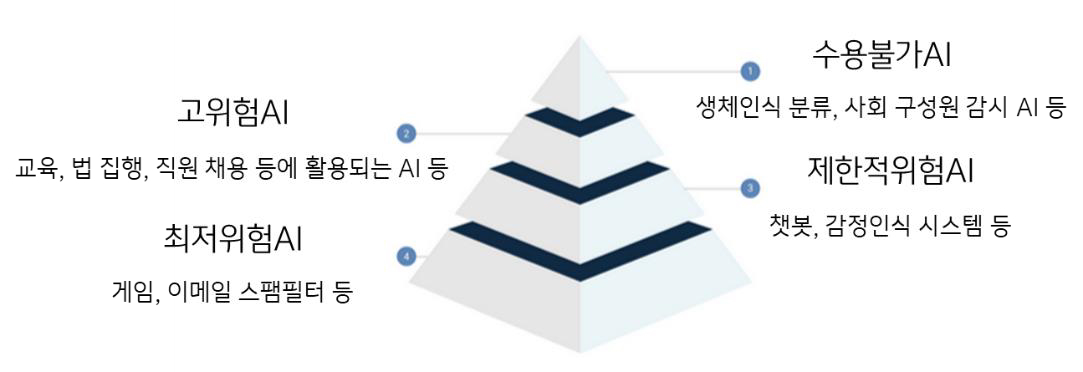

○ AI 시스템을 ‘수용 불가 AI’, ‘고위험 AI’, ‘제한적 위험 AI’, ‘최저 위험 AI’의 네 단계로 분류

[그림 1] 「AI법」의 네 가지 AI 시스템 구분

자료: EU

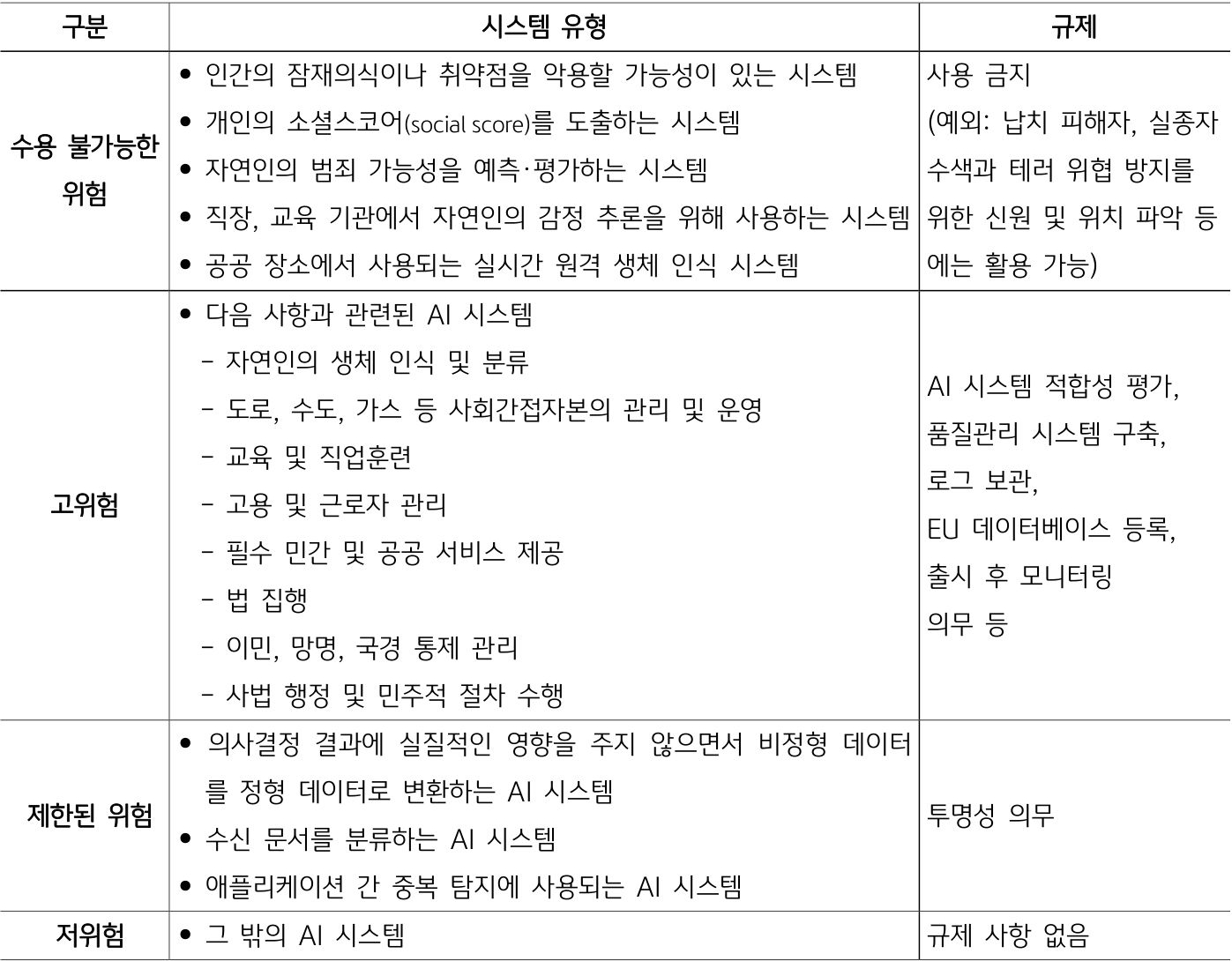

○ ‘수용 불가 AI’는 인간의 존엄성·자유·평등·차별 금지·민주주의·법치주의 등 EU의 기본 가치를 위배하는 AI 시스템으로, 특별한 예외 규정이 없는 한 원칙적으로 사용 불가

• 성별·인종 등에 기반한 생체 인식 분류를 비롯해 사회적 차별을 심화하거나 개인의 민감한 정보를 추론하는 AI, 사회 구성원 감시에 활용되어 자유와 권리를 침해하는 시스템이 해당됨

• 위반 시 3천500만 유로(약 527억 원)와 전년도 글로벌 매출액의 7% 중 더 큰 금액이 벌금으로 부과됨

○ ‘고위험 AI’는 교육·법 집행·직원 채용 등에 활용되어 인간의 건강·안전·기본권에 중대한 위험성을 초래할 수 있는 AI 시스템을 의미

• 출시 전 AI 시스템 관련 정보 공개의 투명성·신뢰성·보안·기술명세서 등에 관한 적합성 평가를 받아야 하며, 출시 이후에도 이와 관련한 지속적인 모니터링과 보고가 필요

• 위반 시 최대 1천500만 유로(약 266억 원)와 전년도 글로벌 매출액의 3% 중 더 큰 금액이 벌금으로 부과됨

○ ‘제한적 위험 AI’는 챗봇 등 인간과 상호작용을 하거나, 딥페이크 등 조작된 정보를 생성하거나, 감정을 인식하는 시스템 등을 의미

• 시스템 제공자는 사용자가 AI 시스템과 상호작용하고 있다는 사실을 고지해야 하는 투명성 의무가 부과됨

• 위반 시 최대 750만 유로(약 113억 원)와 전년도 글로벌 매출액의 1% 중 더 큰 금액이 벌금으로 부과됨

○ ‘최저 위험 AI’는 앞서 언급된 AI 시스템보다 위험이 낮은 AI 시스템을 의미하며, AI를 활용한 비디오 게임 또는 이메일 스팸 필터 등이 해당됨

• 시스템 제공자는 AI 활용으로 발생 가능한 위험을 최소화하기 위한 행동 강령을 작성하고 이를 자발적으로 적용해야 함

○ 발효 6개월 후인 2025년 2월 1일부터 ‘수용 불가 AI’에 대한 규정이 적용되며 「AI법」에 기반한 실질적인 규제가 시작됨

○ 발효 12개월 후인 2025년 8월 1일에는 ‘범용 AI’에 대한 규제가 시작되며, 24개월 후인 2026년 8월 1일에는 ‘고위험 AI’에 대한 규제가 시행됨

• 「AI법」은 앞서 언급한 네 가지 AI 시스템 구분 외에 추가적으로 ‘범용 AI’도 정의하고 있음

- ‘범용 AI’는 거대언어모델과 같이 다양한 업무에 활용 가능한 모델 또는 이를 활용한 시스템을 의미

• ‘범용 AI’ 모델 공급자는 모델의 개발 및 테스트 관련 기록을 보관하고, 모델을 활용하려는 업체에 관련 정보를 제공하며 EU 집행위원회와 협력해야 하는 의무가 부과됨

- 위반 시 최대 1천500만 유로(약 266억 원)와 전년도 글로벌 매출액의 3% 중 더 큰 금액이 벌금으로 부과됨

[표 1] EU 「AI법」에서 정의하는 위험 구분별 주요 AI 시스템 유형 및 규제 사항

자료: 과학기술정보방송통신위원회

[미국]

※ 행정명령은 국민 일반에 대한 강제력 없으며 행정기관 내에서만 효력을 지님

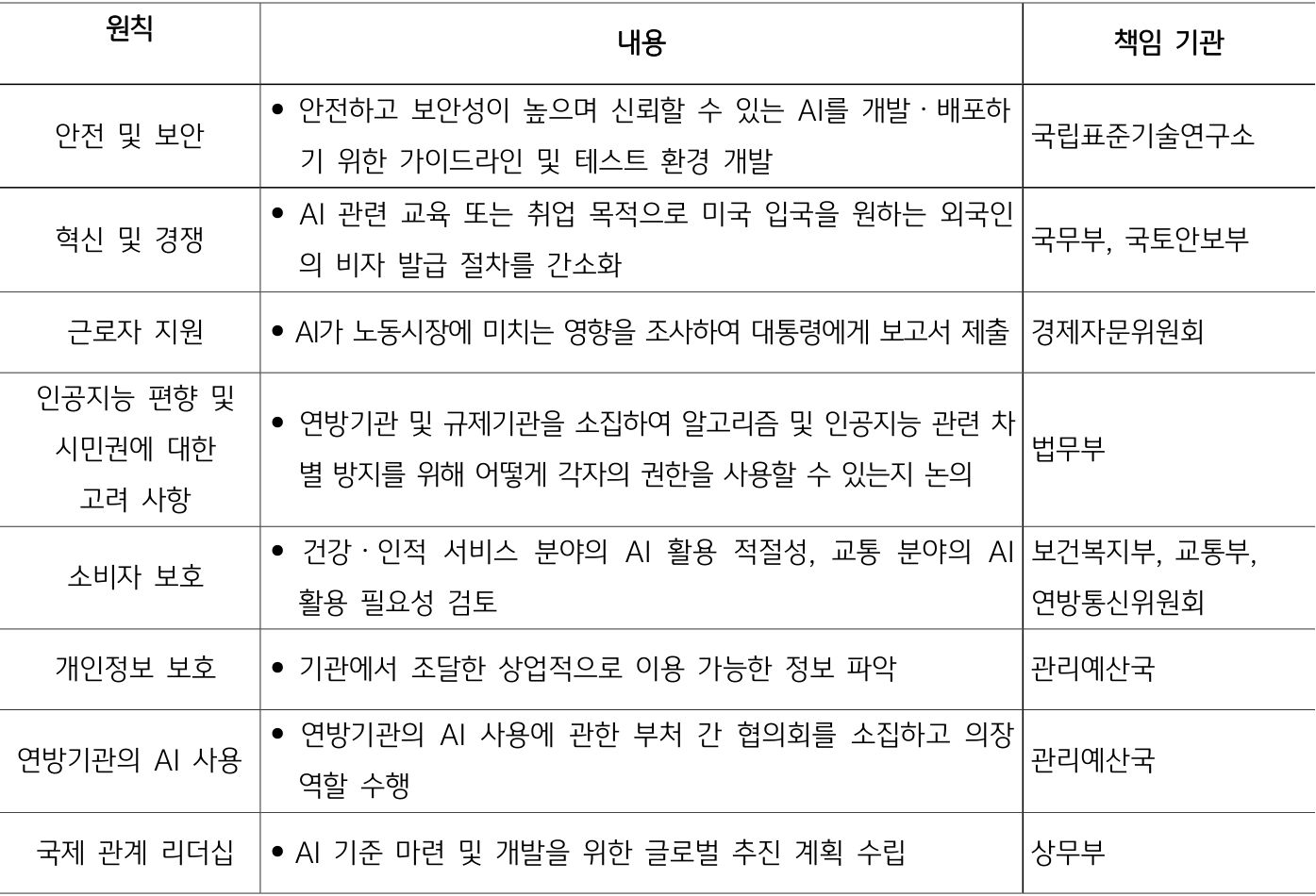

○ 바이든 행정부는 2023년 10월 30일 「안전하고 보안이 보장되며 신뢰할 수 있는 인공지능의 개발과 사용¹에 관한 행정명령」(이하 AI 행정명령)을 발령

• AI가 엄청난 잠재력과 함께 위험을 내포하고 있음을 명시하고 공공과 민간, 학계와 시민사회의 공동 노력으로 위험을 완화해야 한다고 선언

• AI 시스템의 개발 및 사용 과정에서 행정부가 준수하여야 하는 여덟 가지 원칙을 규정하고 AI 관련 정책 입안 및 이행을 위한 ‘백악관 AI위원회’를 신설

¹ Safe, Secure, and Trustworthy Development and Use of Artificial Intelligence

[표 2] 미국의 AI 행정명령에 포함된 여덟 가지 원칙

자료: 과학기술정보방송통신위원회

○ AI 행정명령은 EU의 「AI법」과 같은 체계적인 법 체계에 해당하지 않지만, 연방 차원의 AI 규제 시도로서 의의가 있음

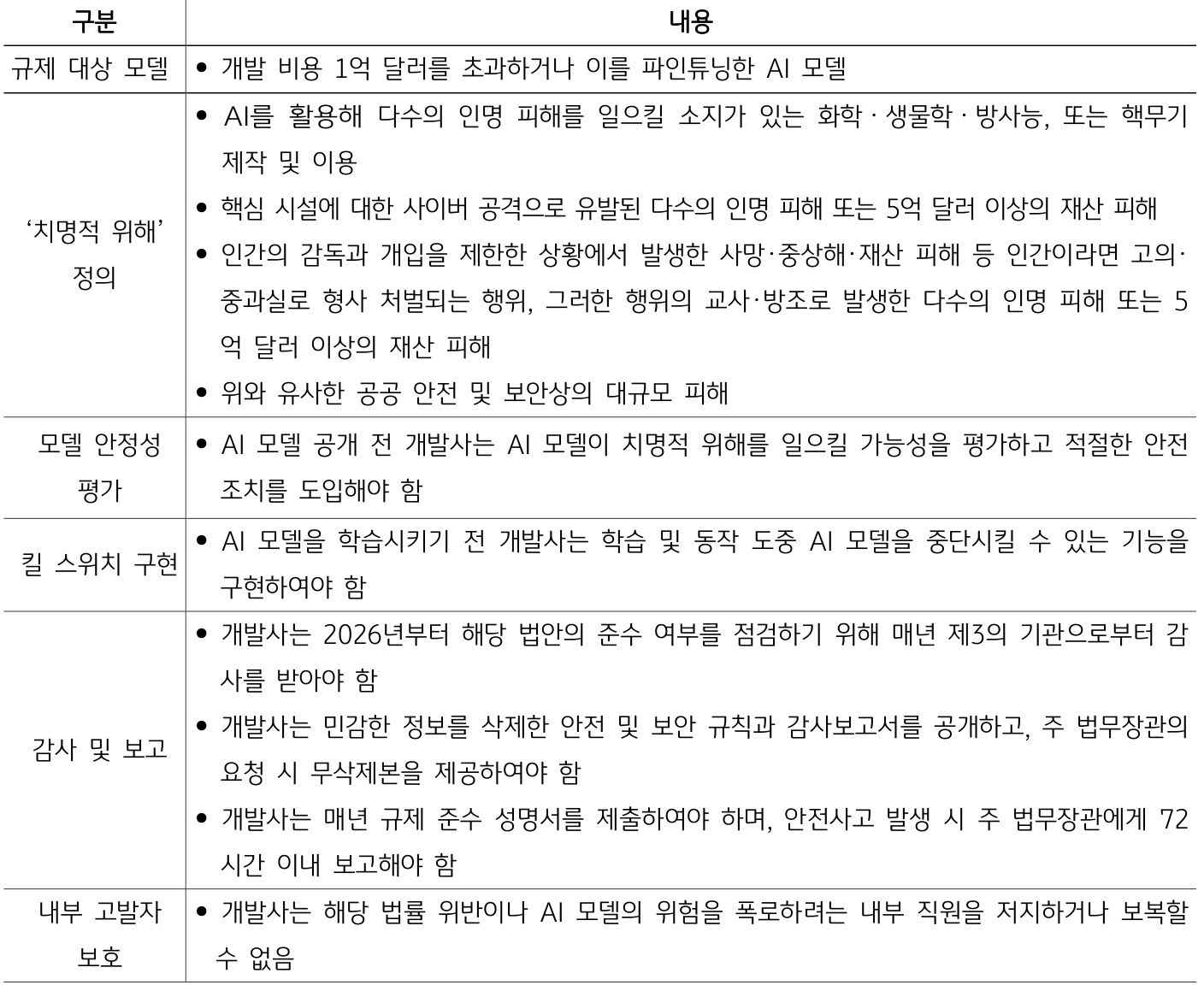

○ 캘리포니아주에서는 지난 8월 AI 규제 법인 「첨단 AI 모델을 위한 안전 및 보안 혁신법」² (이하 SB1047)이 주 의회를 통과

• 규제 대상에 해당하는 AI 모델은 공개 전 ‘안전성 테스트’를 실시하고, AI 모델이 문제를 일으킬 경우 즉시 작동을 중단시킬 수 있는 ‘킬 스위치(Kill Switch)’ 기능 구현을 의무화

- 개발 비용 1억 달러를 초과하는 AI 모델이 규제 대상에 해당하며, AI 모델이 ‘치명적 위해(critical harm)’를 일으킬 가능성이 없는지 사전에 검증하는 안전성 테스트를 의무화

- AI 모델이 문제를 일으킬 경우 즉시 작동을 중단시킬 수 있는 기능을 구현해야 하며, 기업이 개발한 AI 모델의 문제점을 고발하는 ‘내부 고발자’에 대한 보호 조치도 마련해야 함

- AI가 인명 피해나 5억 달러 이상의 재산 피해를 일으킬 경우 주 법무장관은 개발사를 대상으로 민사 소송을 제기할 수 있음

² The Safe and Secure Innovation for Frontier Artificial Intelligence Models Act

[표 3] SB1047 주요 내용

자료: 캘리포니아주 법률 정보(California Legislative Information), 언론 종합

○ SB1047은 미국의 첫 AI 규제 법이면서 빅테크를 포함한 다수의 AI 기업이 소재하는 캘리포니아주에서 마련된 법안이라는 점에서 의의가 있음

• 구글, 메타, 오픈AI, 앤트로픽 등 주요 AI 기업은 캘리포니아주에 기반을 두고 있으며, 본사 소재지에 상관없이 캘리포니아주에서 사업하는 모든 기업은 SB1047 적용 대상에 포함됨

• 다만, 주 의원들과 달리 일부 연방 의원들은 SB1047의 필요성에 대해 의문을 제기

- 캘리포니아주 의원들은 연방 정부가 AI 규제에 소극적이므로 주 차원에서 규제에 나서야 한다고 주장

- 그러나 낸시 펠로시 등 일부 연방 의원들은 SB1047이 기업 혁신을 저해하며 주 차원의 규제 법은 필요하지 않다고 주장

○ SB1047은 개빈 뉴섬(Gavin Newsom) 캘리포니아 주지사가 최종 승인하지 않아 현재 법제화가 보류된 상태

• 뉴섬 주지사는 SB1047이 대규모 AI 모델에만 적용되어 한계가 있다고 지적하며, ‘AI 대모’로 불리는 페이페이 리(Fei-Fei Li) 스탠퍼드대 교수 등과 함께 새로운 법안을 추진하고 있다고 밝힘

○ 미국의 비영리 공공정책 연구기관인 알스트리트연구소(R Street Institute)³는 지난 11월 트럼프의 재선에 따라 바이든 행정부의 AI 행정명령이 철회되고 AI 정책이 감독 강화에서 규제 완화로 선회할 것으로 예측

• 트럼프는 2023년 12월 선거 유세와 2024년 7월 공화당 전국위원회에서 AI 혁신을 저해하는 바이든 행정부의 AI 행정명령을 철회하겠다고 밝힘

³ 2012년 설립되어 워싱턴 DC에 본부를 두고 있음

[기타]

○ EU·미국·영국 등은 지난 9월 AI 규제를 위한 국제 조약⁴에 서명. AI 기술 개발을 주도하는 주요 주체들을 중심으로 최초로 AI 규제를 위한 글로벌 기준을 제시

• AI가 인간에게 해롭거나 차별적인 결과를 도출하는 경우 해당 시스템이 개발된 국가에 책임이 있으며, 인간의 평등과 개인정보 보호 권리를 존중하는 방향으로 개발되어야 함을 명시. 조약은 크게 세 가지 특징을 보임

① EU 「AI법」과 유사하게 AI 시스템의 위험성을 중심으로 접근하며, AI 시스템은 물론 이를 활용하여 생성한 콘텐츠의 투명성과 고위험 AI 시스템에 대한 규제를 강조

② AI 시스템 사용에 관한 투명성 및 책임성을 보장하기 위해 관련 정보를 문서화하고 AI 시스템에 영향을 받는 주체에게 이를 제공하며, 효과적인 이의 제기 절차를 마련할 것을 규정

③ AI 시스템의 잠재적인 위험 관리를 위해 정기적인 위험 및 영향 평가를 시행

• 이 조약은 캐나다·이스라엘·일본·호주 등 50여 개국이 2년에 걸쳐 초안을 마련. 아이슬란드·이스라엘 등도 조약에 서명하였으며 향후 다른 국가들도 참여할 것으로 예상(한국은 현재 미참여)

⁴ Council of Europe Framework Convention on Artificial Intelligence and Human Rights, Democracy and the Rule of Law

○ 중국은 미·중 기술패권 경쟁 속 자국의 AI 발전을 지원하는 방향으로 AI 규제를 추진 중

• 2023년 8월 AI에 대한 감독을 강화하기 위해 ‘생성형AI 서비스 잠정 관리 방법’을 시행

- AI의 건전한 발전과 표준화를 추진하고 국가 안보, 사회 공공의 이익과 권익 보호를 추구하는 동시에 AI 기술 개발 촉진을 위한 지원 체계를 제시하여 AI 산업의 혁신과 발전을 장려

• 2023년 10월 개발도상국의 이해관계를 중시한 ‘글로벌 AI거버넌스 이니셔티브’를 발표하여 AI 관련 규제 및 표준에 대한 국제적 리더십 구축을 시도

• 2024년 3월 ‘전문가 제안’이라고 불리는 AI 법안 초안을 공개. AI로 인한 위험으로부터 사용자를 보호하는 내용도 포함되어 있지만, 우선적으로 AI 산업 발전에 초점을 맞추고 있음

○ 영국과 일본도 각자 AI 관련 규제를 추진 중

• 영국은 2023년 11월 세계 최초로 AI 관련 글로벌 정상회담인 「AI 안전성 정상회의(AI Safety Summit)」를 개최하였으며, 2024년부터 AI 법률 제정에 관해 논의 중

• 일본은 지난 5월 AI 규제 법 마련을 위한 검토를 시작하였다고 발표

○ 한국은 다수의 AI 관련 법률이 발의되었으나 아직 정식 법제화된 경우는 없으며, 정부에서 AI가 안전하게 활용될 수 있도록 권고안을 마련하여 적용하고 있는 상황

• 금융위원회는 금융 서비스 분야의 AI 활용과 관련하여 금융 소비자 보호 및 금융시장 건전성 확보를 위해 「금융 분야 AI 가이드라인」을 발표(2021년 7월)

• 국가인권위원회는 AI 개발 및 활용 과정에서 발생할 수 있는 인권 침해와 차별 방지를 위해 「인공지능 개발과 활용에 관한 인권 가이드라인」을 발표(2022년 5월)

• 개인정보보호위원회는 개인정보 침해 위험을 최소화하면서 AI 발전에 필요한 데이터를 안전하게 활용하기 위한 「인공지능 시대 안전한 개인정보 활용 정책 방향」을 발표(2023년 8월)

금융용어사전

금융용어사전