◼ 많은 금융기관이 콜센터 효율화를 위해 챗봇·음성봇 등의 AI 상담원을 도입했지만, 고객은 오히려 더 큰 불만을 느끼고 있음

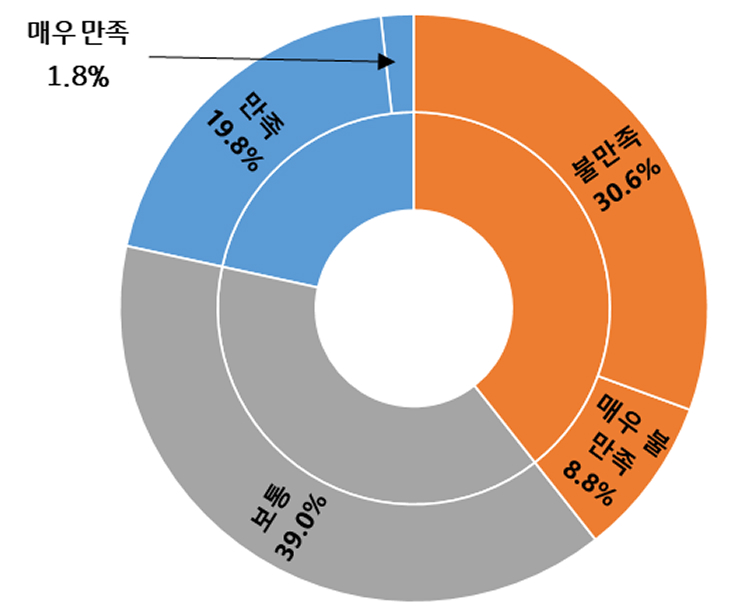

○ 지난해 한 언론이 실시한 ‘금융회사 콜센터 AI 상담 서비스 만족도 조사’¹에 따르면, AI 상담 서비스 만족도는 21.6%(만족 19.8%·매우 만족 1.8%)에 불과하고 불만족이 39.4%(불만족 30.6%·매우 불만족 8.8%)를 차지

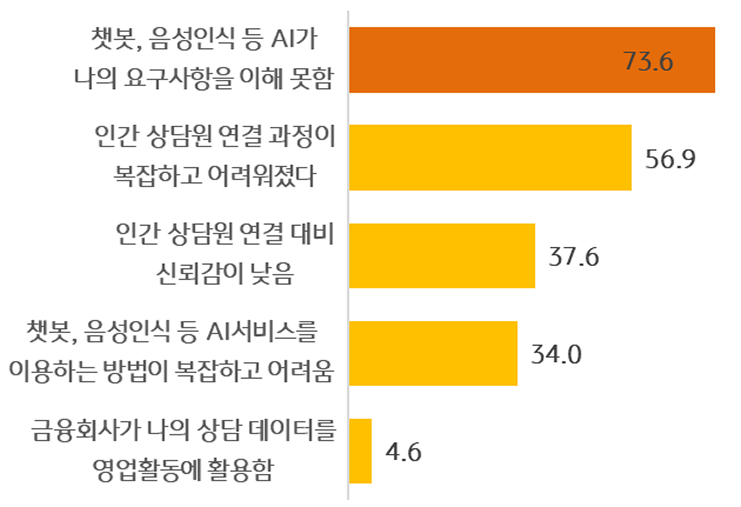

• AI 상담원이 요구사항을 이해하지 못해 불편을 느낀 응답자가 73.6%로 가장 많았고, AI 상담 서비스 이용 후 인간 상담원으로 연결되는 과정에서 불편을 느낀 응답자가 56.9%로 그 뒤를 이음

AI 상담원의 한계: 고객 불만의 현실

작게

보통

크게

AI 상담 서비스의 만족도 현황

주: 단위 %, 전국 성인(만19~69세) 500명 대상 / 자료: 엠브레인, 《아시아경제》

AI 상담 서비스의 불만족 이유

주: 단위 %, 복수응답, 전국 성인(만19~69세) 500명 대상 / 자료: 엠브레인, 《아시아경제》

◼ AI 상담 서비스는 초기에는 고객의 단순 문의 처리에 도움을 줄 것으로 기대됐지만, 현실에서는 AI가 문의 내용을 이해하지 못해 고객이 감정이 상한 채로 상담이 이관되어 인간 상담원이 뒷수습을 해야 하는 일이 잦음

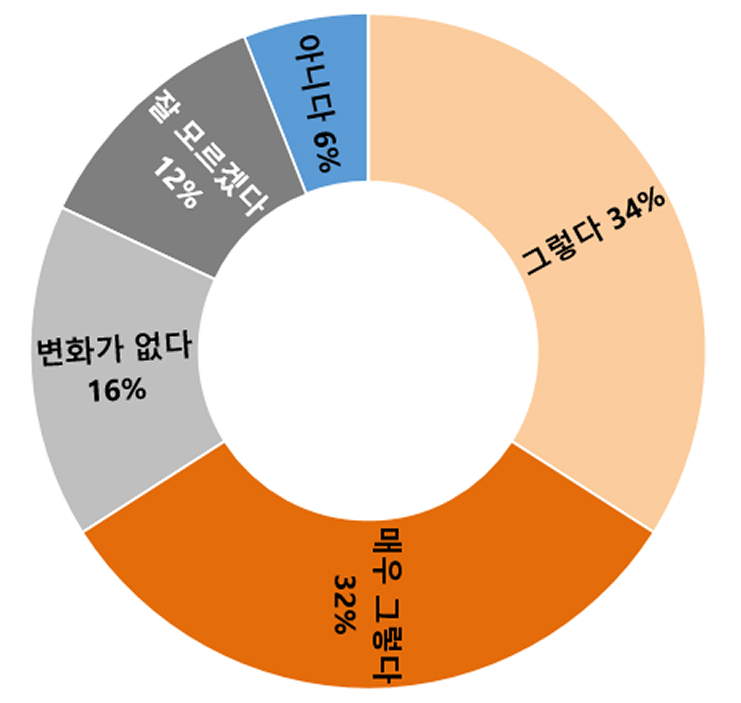

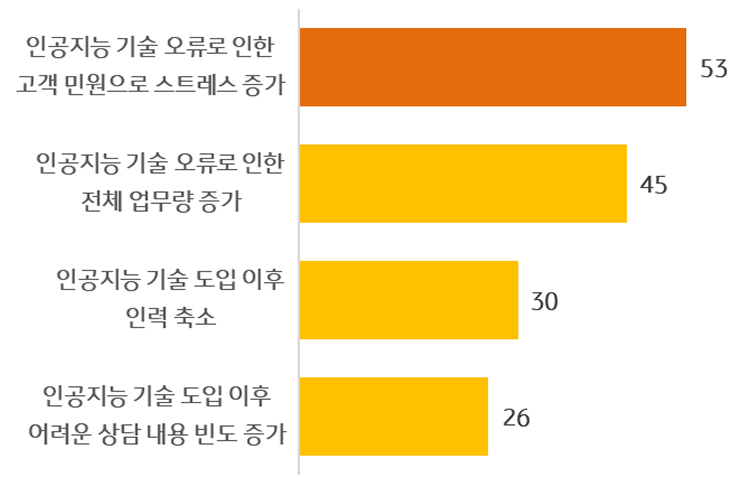

○ AI 상담 서비스 도입 이후 근무 여건이 더 열악해졌다고 느끼는지 묻는 질문에 상담원의 66%(매우 그렇다 32%·그렇다 34%)가 ‘그렇다’라고 답했고, 그 이유로는 53%가 ‘AI 기술 오류로 인한 고객 민원으로 스트레스 증가’를 꼽음²

AI 도입 이후 상담원의 근무 여건 악화 인식

주: 단위 %, 전국 콜센터 상담사 185명 대상 / 자료: 《한겨례》

AI 도입 이후 상담원의 근무 여건 악화 요인

주: 단위 %, 복수응답, 전국 콜센터 상담사 185명 대상 / 자료: 《한겨례》

² 《한겨레》, 2024.6.5, “AI 답변에 화난 고객, 인간 상담사 감정 노동은 더 심해졌다”

◼ 이처럼 ‘어설픈 AI 상담원’의 도입은 단순히 효과가 없는 수준을 넘어, 고객 신뢰를 떨어뜨리고 상담원 피로도를 높이며 문제 해결에 소요되는 시간이 증가하는 역효과를 초래하고 있으며, 문제의 근본적인 원인 중 하나로는 AI 자체의 기술적 한계를 꼽을 수 있음

○ AI는 높은 정확도와 자연어 이해 수준을 요구하는 맥락적 질문에는 여전히 제대로 대응하지 못하며, 규제나 윤리적 판단이 요구되는 복잡한 이슈에 대해서도 무력

• [감정 이해 및 공감 능력 부족] AI 상담원은 구조화된 문의에 대해서는 빠르게 응답하지만, 인간처럼 고객의 감정과 질문 맥락을 파악하는 능력이 부족

- 전문 온라인 미디어기업 CMS와이어(CMSWire)에 따르면, AI는 주문 상태 확인·비밀번호 재설정 등 예측 가능한 요청에는 뛰어나지만, 고객의 감정과 숨겨진 의도를 파악하거나 비언어적 단서를 이해하는 능력은 떨어짐

- 이 때문에 공감 부족, 요구사항 인식 오류, 획일적인 응답이 발생하여 고객은 AI 상담원의 서비스에 불만을 표출하는 경우가 잦음

- ‘AI 챗봇이 고객 서비스에 미치는 영향’을 분석한 한 연구³에 따르면, 46%의 응답자는 AI 상담원의 감정 지능 부족으로 불편을 느꼈다고 밝힘

• [복잡한 상담 처리의 어려움] AI 상담원은 단순 업무는 효과적으로 처리하지만, 다층적인 문제나 복합적인 문의를 처리하는 데에는 한계를 보임

- 앞서 언급한 ‘AI 챗봇이 고객 서비스에 미치는 영향’에 대한 연구에 따르면, AI 챗봇은 일상적인 질문에는 효율적으로 응답했지만 복잡한 문제 처리에는 한계를 보여 54%의 고객이 인간 상담원 연결을 요구

- CMS와이어도 AI가 모호하거나 여러 문제를 포함한 복합적인 요청에 대해서는 인식 오류가 잦아 고객이 불필요한 루프에 빠지게 된다고 지적

• [개인화와 맥락 이해의 한계] AI 상담원은 데이터 기반으로 응답하여 개인화 능력이 부족

- ‘AI 챗봇이 고객 서비스에 미치는 영향’에 대한 연구에 따르면, AI 챗봇이 맥락 특화 질문을 이해하지 못해 고객 불만이 발생하고 사용자 의도 인식 오류율은 23%에 달함

- 반면 인간 상담원은 고객의 이력과 질의 내용의 미묘한 뉘앙스를 감지할 수 있어 AI보다 개인화 능력이 뛰어남

• [사생활과 보안 우려] AI 상담원은 민감한 고객 정보를 다루는 만큼 데이터 보호와 보안 위험이 존재

- 은행들이 AI 챗봇 도입 시 외부 기술 업체에 의존하면서 데이터 유출 시 책임 소재가 불분명하다는 위험이 존재

• [설명 가능성 부족과 신뢰 문제] 법률·금융 등 고위험 분야에서는 AI의 답변 도출 과정을 설명할 수 있어야 함

- 전문가들은 법률 서비스 AI가 입출력 결과만 보여주고 중간 처리 과정에 대한 설명이 누락되어 사용자 신뢰를 저하시킨다고 지적

- 사용자가 AI 결과를 지나치게 신뢰하는 ‘자동화 편향’을 방지하기 위해서는 ‘설명 가능한 AI(Explainable AI)⁴’의 도입이 필요

• [고비용과 관리상의 어려움] AI 상담 시스템을 유지하기 위해서는 AI 모델의 지속적인 데이터 학습과 업데이트가 필요해 높은 유지 비용이 발생

⁴ 설명가능한 AI(XAI, Explainable AI)는 인공지능이 내린 결정이나 예측의 근거와 과정을 사람이 이해할 수 있도록 설명해 주는 기술 및 연구 분야. 이는 복잡한 '블랙박스'로 여겨지던 AI 모델의 투명성과 신뢰성을 확보하기 위해 등장

○ AI와 인간 상담원 간의 협업 체계 부재도 문제로 지적됨. AI에서 인간 상담원으로 고객 문의가 원활히 이관되지 않거나 필요한 맥락 정보가 함께 전달되지 않아, 인간 상담원이 처음부터 다시 상황을 파악해야 하는 경우가 잦으면서 고객 경험 악화로 이어짐

※ 본 보고서는 연구자의 개인 의견으로 KB경영연구소 공식 의견과 다를 수 있으며, 인용시 출처를 밝혀주시기 바랍니다.제약 요인으로 작용할 수 있음

![[미리보기] AI와 인간의 협업을 통한 금융 상담 혁신](https://cdn.kbthink.com/content/dam/tam-dcp-cms/webadmin/thumbnail/investment-02-pc.jpg)