HBM이란? AI 반도체 전쟁의 승패를 가를 고대역 메모리

작게

보통

크게

목차

3줄 요약

- HBM(고대역 메모리)은 D램 칩을 수직으로 층층이 쌓아 AI 연산에 필요한 데이터를 초고속으로 처리하는 메모리예요.

- AI 시장은 승자독식 구조라 빅테크 기업들이 최고 성능의 칩을 확보하기 위해 치열하게 경쟁하고, 그 칩엔 반드시 HBM이 필요해요.

- TSV 적층·수율·발열·패키징이 모두 맞물려야 만들 수 있는 고난도 기술인 만큼, HBM 기술을 쥔 메모리 기업들이 다음 AI 시대의 패권을 다투고 있어요.

HBM 뜻

HBM이란?

HBM은 High Bandwidth Memory의 줄임말로, 우리말로는 ‘고대역 메모리’라고 불러요.

AI 연산에 필수적인 ‘메모리’

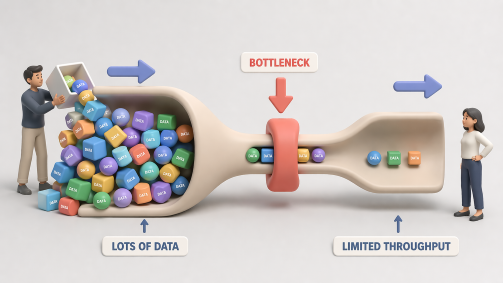

HBM을 이해하려면 먼저 AI 연산이 어떻게 이루어지는지 알아야 해요. 챗GPT 같은 AI가 질문에 답하려면 수십억 개의 데이터를 순식간에 계산해야 해요. 이 계산을 맡는 핵심 부품이 GPU(그래픽처리장치)예요. 원래 게임 그래픽 처리용으로 개발됐지만, 수많은 연산을 동시에 처리하는 특성 덕분에 AI의 두뇌 역할을 하게 됐어요.

생성: GPT-5.2

GPU가 연산하려면 처리할 데이터를 메모리에서 끊임없이 불러와야 해요. 메모리는 GPU가 계산에 쓸 데이터를 임시로 저장해두는 공간이에요. 텍스트를 이해하고, 문맥을 파악하고, 답변을 생성하는 모든 과정에서 GPU는 메모리를 수시로 들락날락해요.

D램을 쌓아 올리다

앞서 말한 메모리, 그 대표적인 종류가 바로 D램(DRAM)이에요. PC, 스마트폰, 서버 등 거의 모든 전자기기에 들어가는 가장 일반적인 메모리 반도체예요. HBM도 D램의 일종인데, 만드는 방식이 완전히 달라요.

D램, HBM 차이점

기존 D램은 칩 하나를 평면으로 쓰는 구조예요. HBM은 이 D램 칩 여러 장을 층층이 수직으로 쌓아 올린 구조예요. 기존 D램이 단독주택이라면, HBM은 이 단독주택을 수직으로 높게 쌓아 올린 아파트인 셈이에요.

이 층들을 연결하는 게 TSV(Through Silicon Via·실리콘 관통 전극) 기술이에요. 층마다 초고속 직통 엘리베이터를 뚫어놓는다고 생각하면 이해하기 쉬워요. 실제로는 각 칩에 머리카락 굵기의 수천 분의 1 수준인 미세한 구멍을 수직으로 뚫고, 그 안에 전도성 소재를 채워 층과 층 사이를 전기적으로 연결해요.

생성: GPT-5.2

이 구멍을 통해 데이터가 위아래로 이동하기 때문에, 칩을 많이 쌓을수록 한 번에 주고받을 수 있는 데이터의 양도 늘어나요. HBM4 기준 초당 약 3.0TB의 데이터를 처리할 수 있는데, 이는 4K 영화 약 630편을 1초에 전송하는 속도예요.

완성된 HBM은 메모리 슬롯에 꽂는 방식이 아니에요. 인터포저(Interposer)라는 특수 기판 위에 GPU 칩과 HBM을 나란히 올려붙여요. GPU 바로 옆에 물리적으로 붙어 있으니 데이터 이동 거리가 극도로 짧아지고, 그만큼 속도는 빠르고 전력 소모는 줄어들어요.

엔비디아 AI칩과 HBM의 관계

수요가 공급을 앞지르다

엔비디아 GPU의 짝꿍

HBM이 주목받기 시작한 건 엔비디아의 AI 가속기와 맞물리면서부터예요. 엔비디아의 H100, B200 같은 AI칩은 수천 개의 연산을 동시에 처리하는 수준의 성능을 갖추고 있어요. 문제는 이 성능을 온전히 끌어내려면 메모리도 그 속도를 받쳐줘야 한다는 거예요. 일반 메모리로는 따라가지 못해요. 앞서 설명한 것처럼 GPU 바로 옆에 붙여 데이터 이동 거리를 극도로 줄이는 인터포저 방식, 즉 HBM이어야만 해요.

엔비디아가 잘 나갈수록, HBM도 잘 나가요

챗GPT의 등장 이후 AI 인프라 투자가 폭발적으로 늘면서, 엔비디아 GPU 수요도 함께 치솟았어요. GPU가 팔릴수록 HBM 수요도 같이 올라가는 구조예요. 2025년 상반기 기준, 엔비디아는 SK하이닉스 전체 매출의 27%를 차지하는 최대 고객이 됐어요. 반도체 기업 하나가 고객사 한 곳에 이만큼 의존하는 건 이례적인 일이에요. 반대로 말하면, 엔비디아 AI칩이 잘 팔릴수록 SK하이닉스의 실적도 자동으로 따라 올라가는 구조가 만들어진 거예요.

🚀 폭발적 수요가 바꾼 업계 지형도

수요가 얼마나 폭발적이냐면, SK하이닉스는 이미 2026년까지 생산할 HBM 물량을 전부 팔아버렸어요. 주문을 받아도 더 공급할 재고가 없는 상황이에요. 덕분에 HBM4 공급 단가는 이전 세대 대비 50% 인상됐고, SK하이닉스는 2025년 연간 영업이익 47조 2,000억원이라는 역대 최대 실적을 기록했어요. 영업이익률은 무려 49%에 달하고요. 물건 100원어치 팔면 49원이 이익으로 남는 구조예요.

이 기록적인 실적은 업계 서열 자체를 바꿔놓는 데까지 이어졌어요. 수십 년간 메모리 반도체 시장 1위를 유지하던 삼성전자를 SK하이닉스가 처음으로 추월한 거예요. 2025년, SK하이닉스는 삼성전자를 제치고 글로벌 메모리 반도체 매출 1위에 올랐어요. HBM 한 제품이 업계의 서열을 바꿔버린 거예요.

TSV 적층과 수율의 기술 장벽

진짜 싸움은 수율에서 시작돼요

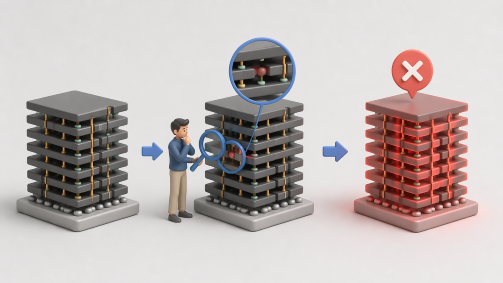

앞서 설명한 TSV, 사실 구현 자체가 엄청난 난도예요. 나노미터 단위의 미세한 구멍을 수천 개 뚫는 작업인데, 단 하나라도 균일하지 않으면 전기 신호가 불안정해지고 칩 전체가 불량이 돼요. 수백 개의 공정이 겹겹이 쌓이는 과정에서 어떤 오차도 허용되지 않아요. 그런데 TSV를 완벽하게 구현했다고 끝이 아니에요. 또 하나의 벽이 남아 있거든요. 바로 수율이에요.

수율 유지가 관건이에요

HBM은 칩 여러 장을 쌓는 구조라, 각 층의 불량 확률이 누적으로 곱해져요. 전체 생산량 중 정상 제품의 비율을 '수율'이라고 하는데요. 층 하나의 정상 확률이 99%라도 8층을 쌓으면 전체 수율은 92%로 떨어지고, 12층이면 89%까지 내려가요. HBM4는 최대 16층까지 쌓아요. 층수가 늘수록 정상 제품을 얻기가 기하급수적으로 어려워지는 거죠. 이 수율을 안정적으로 유지하려면 수년간의 공정 노하우가 필수예요. 돈을 쏟아붓는다고 단기간에 따라올 수 있는 기술이 아닌 셈이죠.

생성: GPT-5.2

열을 잡아야 칩이 산다

칩을 여러 장 겹쳐 쌓으면 또 하나의 문제가 생겨요. 바로 열이에요. AI 연산을 돌리면 칩에서 엄청난 열이 발생하는데, 여러 층이 밀착된 구조에서는 이 열을 효율적으로 빼내는 게 매우 까다로워요. 층 사이의 열이 제대로 분산되지 않으면 칩의 성능이 저하되거나 수명이 크게 줄어들거든요.

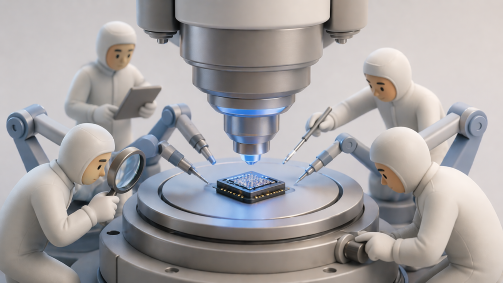

여기에 더해 HBM을 GPU와 함께 인터포저 위에 패키징하는 공정도 고난도 영역이에요. 칩과 기판 사이를 전기적으로 연결하는 미세한 금속 돌기인 범프(bump)를 수만 개 정밀하게 정렬해 붙여야 하는데, 정렬이 0.1마이크로미터만 어긋나도 불량이 돼요. 결국 HBM 제조는 적층 기술, 수율 관리, 발열 제어, 패키징까지 모든 단계가 맞물려 돌아가야 비로소 완성되는 종합 예술이에요.

HBM3E에서 HBM4로

더 높이, 더 빠르게, 더 정교하게

본격적으로 시작된 HBM4 전쟁

지금 이 순간 전 세계 데이터센터에서 돌아가는 AI 대부분은 엔비디아 H100, H200 칩을 기반으로 해요. 이 칩들에 탑재된 메모리가 바로 HBM3E예요. 초당 약 1.2TB의 데이터를 처리하는 현재의 주력 제품이에요.

그다음 세대인 HBM4가 올해부터 본격 양산에 들어가요. 엔비디아의 차세대 AI칩 '루빈(Rubin)'에 탑재될 제품으로, 단순히 속도만 높아진 게 아니에요. HBM4부터는 구조 자체가 달라져요. 기존에는 D램 칩만 쌓았다면, HBM4는 하단에 로직 다이(logic die)라는 별도의 제어 칩을 추가해 데이터 처리를 더 정교하게 할 수 있어요. 메모리와 파운드리 기술이 처음으로 결합되는 거예요.

더 높이, 더 빠르게

HBM3E는 8단 또는 12단을 쌓아요. HBM4는 최대 16단까지 올라가며 저장 용량이 늘어요. 동시에 핀당 데이터 전송 속도도 빨라져 대역폭은 초당 약 3.0TB로 HBM3E 대비 크게 향상됐어요.

💡 HBM4E, HBM5 개발도 진행 중

HBM4E는 2026년 하반기 샘플 공급을 거쳐 2027년 양산을 목표로 개발이 순조롭게 진행 중이에요. 업계에서는 이미 그 이후 세대인 HBM5 개발에도 착수한 상태예요.

하지만 쌓으면 쌓을수록 앞서 설명한 수율 문제가 심화돼요. 발열도 마찬가지예요. 층이 늘어날수록 칩 내부에서 발생하는 열은 커지는데, 이를 효율적으로 빼내는 기술이 함께 따라줘야 해요. 전력 소모 역시 AI 데이터센터 전체의 전력 효율과 직결되는 문제예요.

생성: GPT-5.2

여기에 HBM4부터는 로직 다이에 4나노 수준의 파운드리 공정을 적용해야 해요. 메모리 제조 기술만으로는 부족하고, 최첨단 파운드리 역량까지 갖춰야 경쟁할 수 있는 거예요.

다음 메모리 산업의 패권은 단순히 칩을 높이 쌓는 곳이 아니라, 수율·발열·전력·파운드리 공정이라는 네 가지 벽을 동시에 넘어서는 곳이 차지하게 될 거예요.

우리나라 반도체 기업이 주목받는 이유

처음 질문으로 돌아와 볼게요. 왜 전 세계 투자자들은 한국의 반도체 기업에 그토록 주목할까요? 답은 '대체 불가능한 기술력'에 있어요.

✨ HBM을 만드는 회사는 단 세 곳

현재 전 세계에서 HBM을 제대로 만들 수 있는 회사는 단 세 곳뿐이고, 그중에서도 가장 앞서 있다는 평가를 받는 곳이 바로 우리 기업들이에요. HBM은 AI 칩을 구성하는 핵심 부품으로, AI 열풍과 함께 그 가치가 급격히 부상했죠. 누구나 만들 수 없는 기술을 가졌기에, 우리 기업들이 시장에서 강력한 '가격 결정권'을 쥐게 된 거예요.

AI 시장은 승자독식(Winner-takes-all) 구조입니다. 최고 성능의 칩을 확보하려는 빅테크 기업들의 수요는 이미 공급의 한계를 넘어섰죠. 결국 이러한 압도적인 기술 장벽이 기업의 기록적인 수익으로, 그리고 다시 기업의 가치와 주가를 움직이는 강력한 동력으로 이어지는 선순환 구조가 만들어진 셈이에요.

HBM 기술을 쥔 메모리 기업들이 다음 AI 시대의 판을 짜고 있어요. 반도체 전쟁의 다음 라운드는 이미 시작됐어요.

고대역 메모리

HBM 자주 묻는 질문

Q. HBM은 일반 메모리보다 얼마나 비싼가요?

A. HBM은 일반 D램보다 수십 배 비싸요. TSV 적층, 수율 관리, 패키징까지 복잡한 공정이 겹치는 데다 공급할 수 있는 기업이 극히 적기 때문이에요. 엔비디아 H100 GPU 한 장에 들어가는 HBM 비용만 GPU 전체 원가의 상당 부분을 차지할 정도예요.

Q. 엔비디아가 직접 HBM을 만들 수 있나요?

A. 엔비디아는 칩을 설계만 하고 직접 제조하지 않는 팹리스(fabless) 기업이에요. HBM 제조는 TSV 공정, 적층 기술 등 반도체 제조 전반에 걸친 전혀 다른 인프라와 노하우가 필요해요. 따라서 엔비디아가 직접 HBM 생산에 뛰어드는 건 현실적으로 어렵고 비효율적이에요.

Q. 챗GPT를 쓸 때도 HBM이 작동하나요?

A. 네, 맞아요. 챗GPT를 비롯한 대부분의 AI 서비스는 엔비디아 GPU가 탑재된 데이터센터에서 구동돼요. 엔비디아 AI칩에는 HBM이 반드시 들어가기 때문에, 우리가 AI와 대화하는 모든 순간 HBM이 함께 작동하고 있는 셈이에요.

Q. 비메모리 반도체는 무엇인가요? 메모리 반도체와 무엇이 다른가요?

A. 메모리 반도체가 데이터를 '저장'하는 창고라면, 비메모리 반도체(시스템 반도체)는 데이터를 '연산·처리'하는 두뇌예요. CPU, GPU, 스마트폰 AP 등이 여기 속하고, 엔비디아의 AI칩도 비메모리예요. 전 세계 반도체 시장에서 비메모리가 약 70%, 메모리가 약 30%를 차지해요. 한국은 메모리 분야에서 세계 1·2위지만, 비메모리는 TSMC·인텔·퀄컴 등이 주도하고 있어요.

Q. 메모리 반도체 점유율 현황은 어떤가요?

A. 전체 메모리 시장은 삼성전자·SK하이닉스(한국)·마이크론(미국) 세 곳이 과점하고 있어요. 카운터포인트리서치에 따르면 2025년 3분기 기준 삼성전자가 매출 1위, SK하이닉스가 2위, 마이크론이 3위예요.

HBM으로 좁히면 같은 기관의 2025년 2분기 기준 SK하이닉스가 점유율 약 62%로 압도적 1위이고, 마이크론이 21%, 삼성전자가 17%로 뒤를 잇고 있어요. 삼성전자는 HBM 수율 문제로 한때 크게 밀렸으나 빠르게 격차를 좁히는 추세예요.

![[4월 5주차] FX 전망](https://cdn.kbthink.com/content/dam/tam-dcp-cms/webadmin/thumbnail/investment-03-pc.jpg)