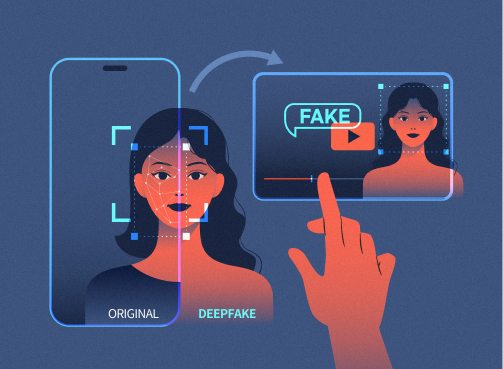

딥페이크(Deepfake)란 인공 지능 심층 학습을 뜻하는 ‘딥 러닝(Deep learning)’과 ‘가짜’를 뜻하는 ‘페이크(Fake)’의 합성어로, AI 기술을 활용해 실제와 구별하기 어려운 가짜 이미지나 영상물을 의미합니다.

여기에 목소리를 복제하는 딥보이스(DeepVoice) 기술까지 더해지며, 단순히 눈에 보이는 모습뿐 아니라 한 사람의 특유의 말투나 억양까지 흉내낼 수 있게 되었어요.

문제는 이러한 기술이 누구나 쉽게 접근할 수 있을 만큼 대중화되었다는 점인데요. 전문 지식 없이도 실제와 똑같은 가짜를 단시간에 만들 수 있다는 특성 때문에, 이를 악용한 범죄가 일상 속으로 빠르게 파고들고 있습니다.